OpenAI war lange Zeit der Goldstandard für verbraucherorientierte KI-Modelle. Doch China ist entschlossen, die KI-Lücke zu den USA zu schließen. Wer ist der stärkste Konkurrent? DeepSeek R1.

DeepSeek R1 ist nicht einfach nur ein weiterer Chatbot – es ist ein auf logisches Denken ausgerichtetes KI-Modell, das die Grenzen herkömmlicher Chatbots durchbrechen soll, indem es komplexe Probleme löst, effizient codiert und seine Denkprozesse transparent erklärt.

Unterdessen ist ChatGPT o3-mini von OpenAI ihr neuestes kosteneffizientes Argumentationsmodell, das ein Gleichgewicht zwischen Effizienz, Erschwinglichkeit und Argumentationstiefe herstellen soll.

Nach stundenlanger Recherche und praktischen Tests beider Modelle haben wir festgestellt, dass der Vergleich von DeepSeek R1 und ChatGPT o3-mini zwei völlig unterschiedliche Philosophien der KI-Entwicklung offenbart. Obwohl sie beide dieselben Probleme lösen, gehen sie diese aus grundlegend unterschiedlichen Blickwinkeln an. Lassen Sie uns herausfinden, welche für SIE die richtige ist!

Wie sind diese Modelle aufgebaut?

o3-mini:

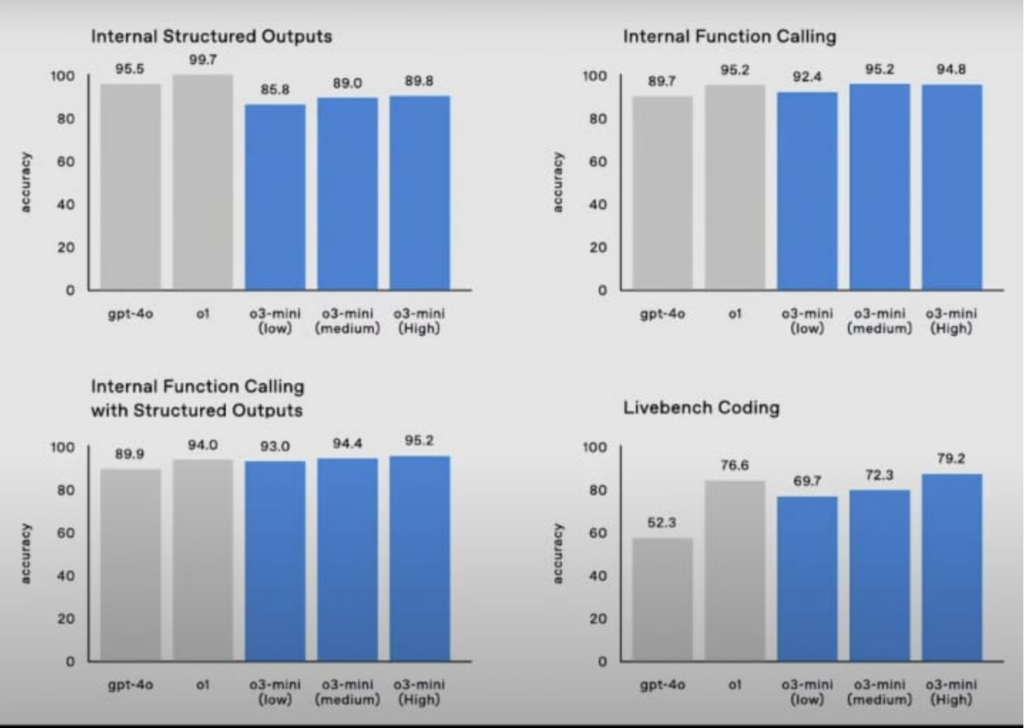

O3-mini von OpenAI ist eine leichtgewichtige Version des O3-Modells, optimiert für schnellere Leistung bei gleichzeitiger Beibehaltung starker Denkfähigkeiten.

Im Gegensatz zu früheren ChatGPT-Modellen mit festen Intelligenzstufen führt o3-mini einen einzigartigen anpassbaren Denkmodus ein, der es Benutzern ermöglicht, je nach Bedarf zwischen niedrigen, mittleren und hohen Denkstufen zu wählen. Diese Funktion ist besonders nützlich, um Reaktionsgeschwindigkeit und -tiefe auszugleichen.

Tiefseek R1:

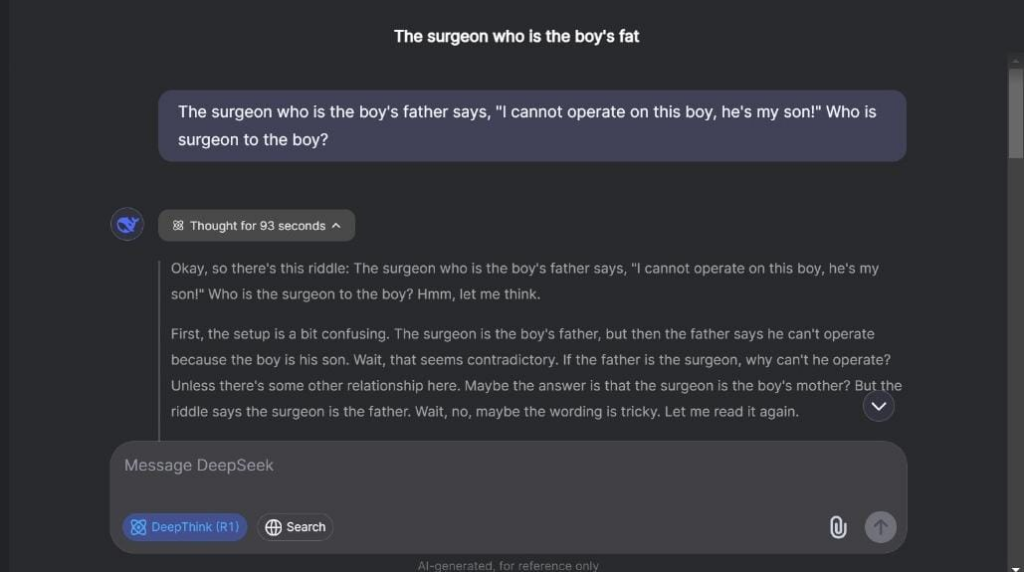

DeepSeek R1, entwickelt von der chinesischen KI-Firma DeepSeek, ist ein Open-Source-KI-Modell, das speziell für mathematisches, logisches und codierungsbezogenes Denken entwickelt wurde. Im Gegensatz zu ChatGPT, das für überwachtes Lernen auf von Menschen markierte Daten angewiesen ist, wurde DeepSeek R1 mithilfe von Verstärkungslernen trainiert, was bedeutet, dass es sich ohne direktes menschliches Eingreifen schrittweise verbessert.

Seine größte Stärke liegt in der Transparenz. DeepSeek R1 gibt nicht einfach nur Antworten, sondern zeigt den gesamten Denkprozess Schritt für Schritt. Das macht es besonders nützlich für technische Bereiche, in denen das Verständnis der Logik hinter einer Antwort genauso wichtig ist wie das Erhalten der Antwort selbst.

Wie gut ist ihre Leistung? (Benchmarks und Einsatz in der Praxis)

Vergleichen wir sie anhand der wichtigsten Bereiche des logischen Denkens und der Problemlösung.

Mathematisches und logisches Denken

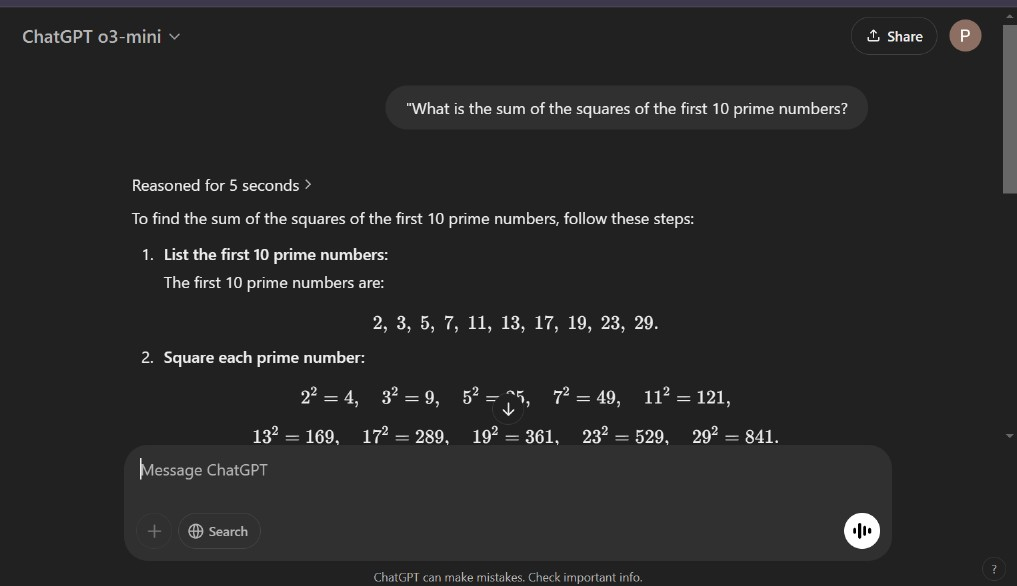

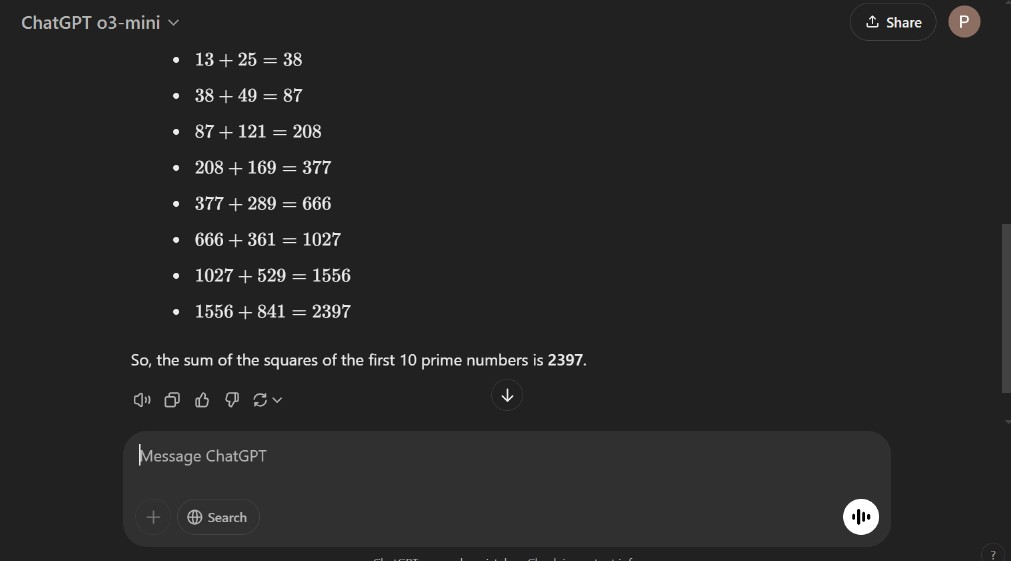

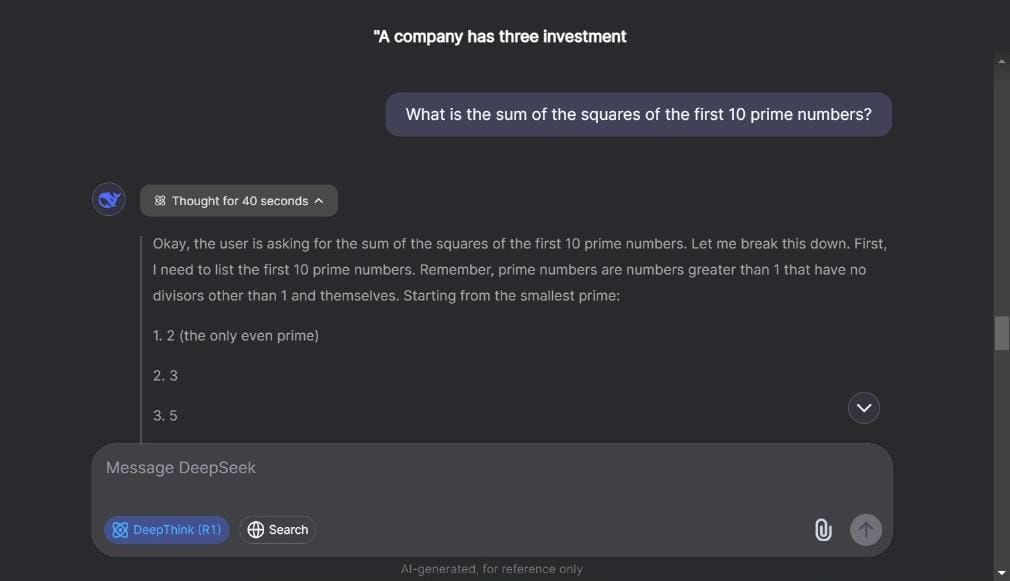

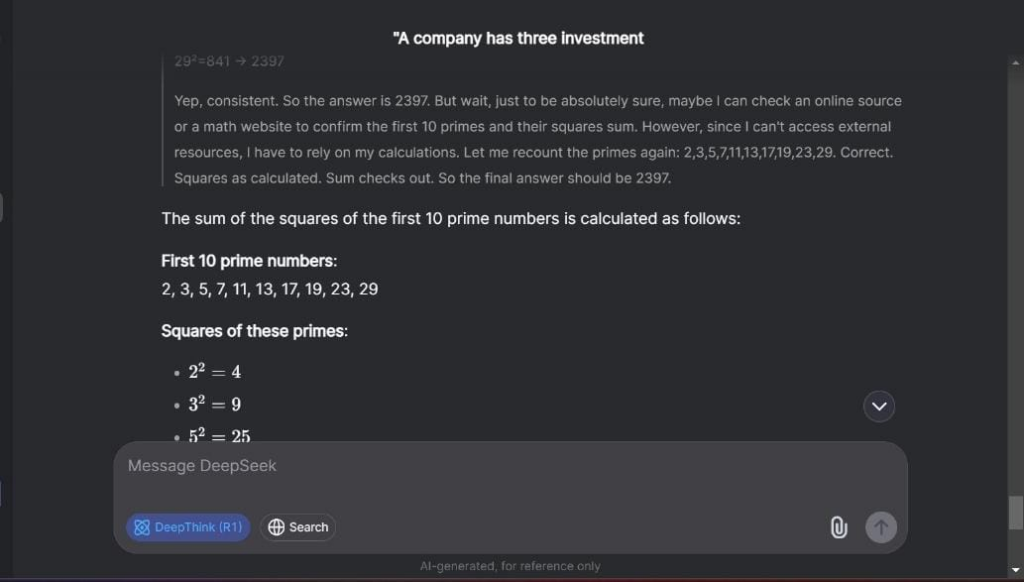

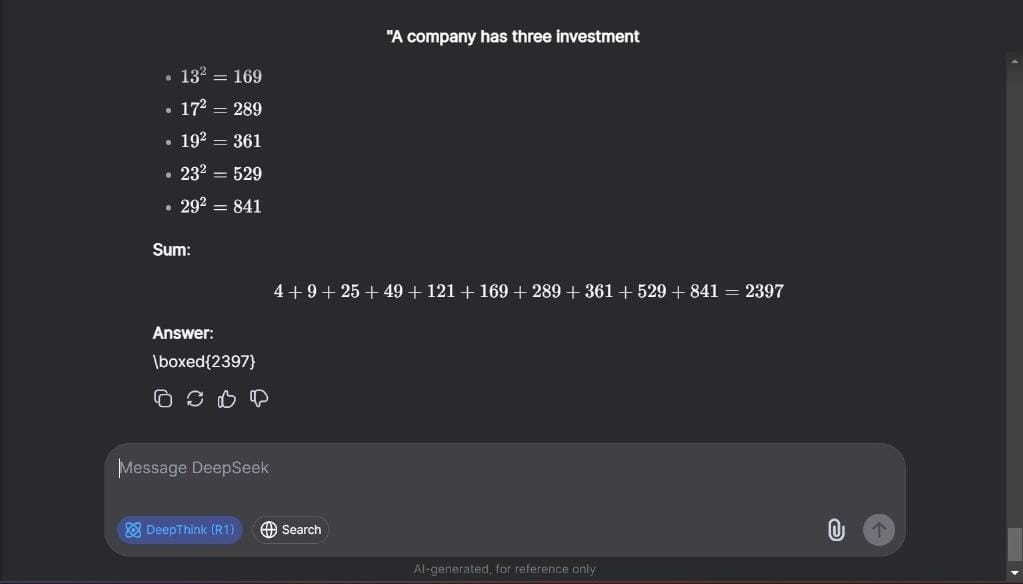

Wir fragten beide Modelle, „Wie hoch ist die Summe der Quadrate der ersten 10 Primzahlen?“

ChatGPT o3-mini lieferte schnell eine Antwort, ohne jedoch unbedingt zu zeigen, wie es zu der Antwort kam, sofern es nicht dazu aufgefordert wurde. In diesem Fall tat es das. Und die Ausgabe war klar und effizient.

DeepSeek R1 würde jede Primzahl zerlegen, die einzelnen Quadrate anzeigen, sie zusammenfassen und dabei eine Erklärung liefern. Der einzige zusätzliche Vorteil hier ist also die Transparenz der Argumentation.

Codierung und Softwareentwicklung

Wir haben beide Tools gebeten, eine Python-Funktion zu optimieren:

- ChatGPT o3-mini würde eine prägnante, optimierte Version der Funktion mit minimaler Erklärung zurückgeben.

- DeepSeek R1 würde nicht nur die Funktion optimieren, sondern auch erklären, warum jede Änderung vorgenommen wurde.

Dadurch eignet sich DeepSeek R1 besser zum Lernen und Debuggen, während ChatGPT o3-mini besser für schnelle Optimierungen auf hoher Ebene geeignet ist.

ChatGPT o3-minis ELO-Bewertung (Codeforces): 2130, was bedeutet, dass die Leistung auf dem Niveau eines wettbewerbsfähigen Expertenprogrammierers liegt.

Codeforces-Bewertung von DeepSeek R1: 1900, etwas unter Expertenniveau, aber immer noch stark.

SWE-Bench-Genauigkeit von DeepSeek R1: 49,2%, was bedeutet, dass es fast die Hälfte der Benchmark-Aufgaben im Software Engineering korrekt löst.

So erfüllen sie weitere wichtige Aufgaben:

| Aufgabe | ChatGPT o3-mini | DeepSeek R1 |

| Generierung von 3D-Animationen (Python) | ❌ Zustellung fehlgeschlagen | ✅ Funktionale Ausgabe |

| Automatisierung der Videobearbeitung | ✅ Gute Ergebnisse | ✅ Gute Ergebnisse |

| PDF-URL-Extraktion (HTML und Python) | ✅ Funktionierender Code | ✅ Funktionierender Code |

Geschäftsdenken

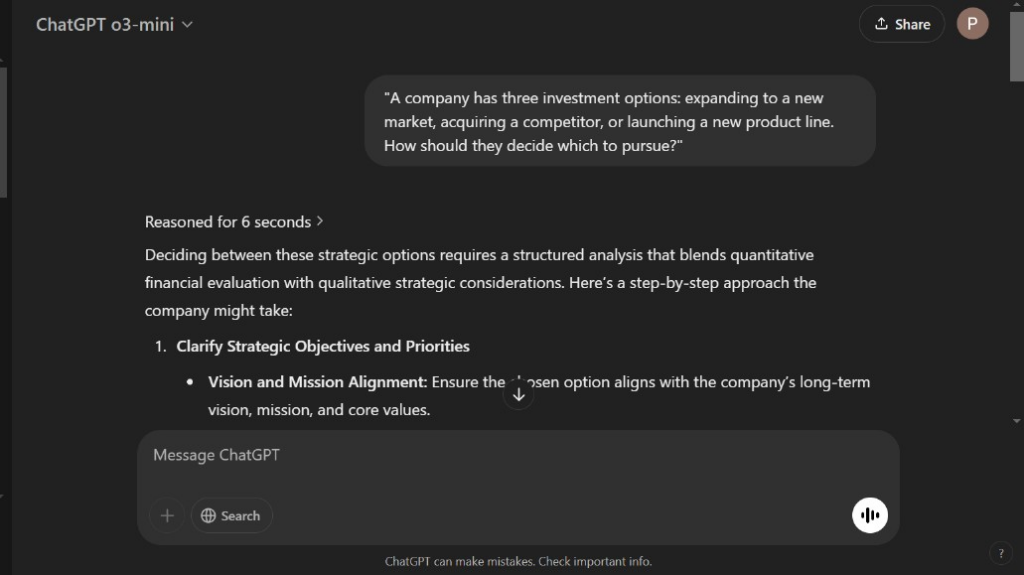

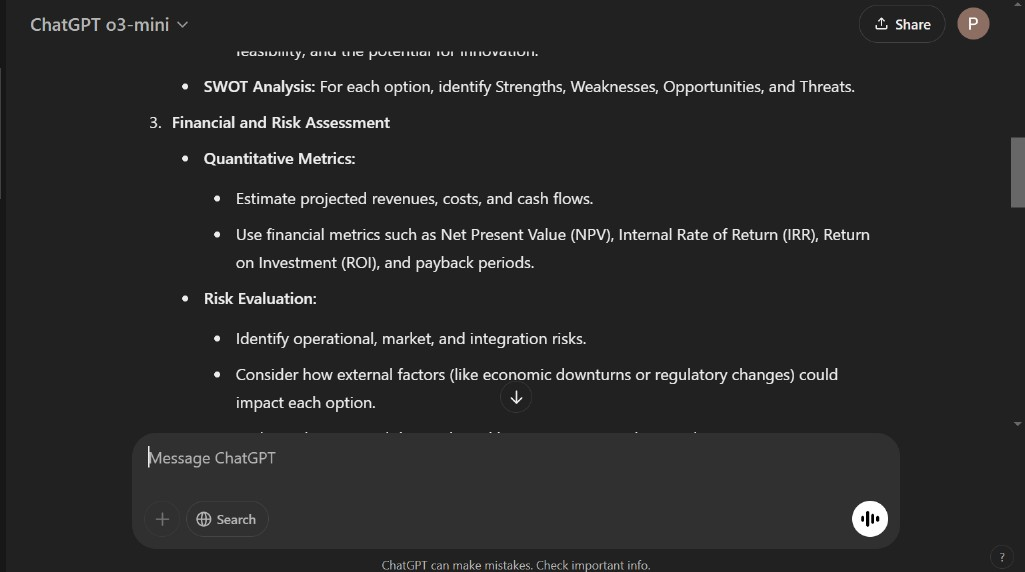

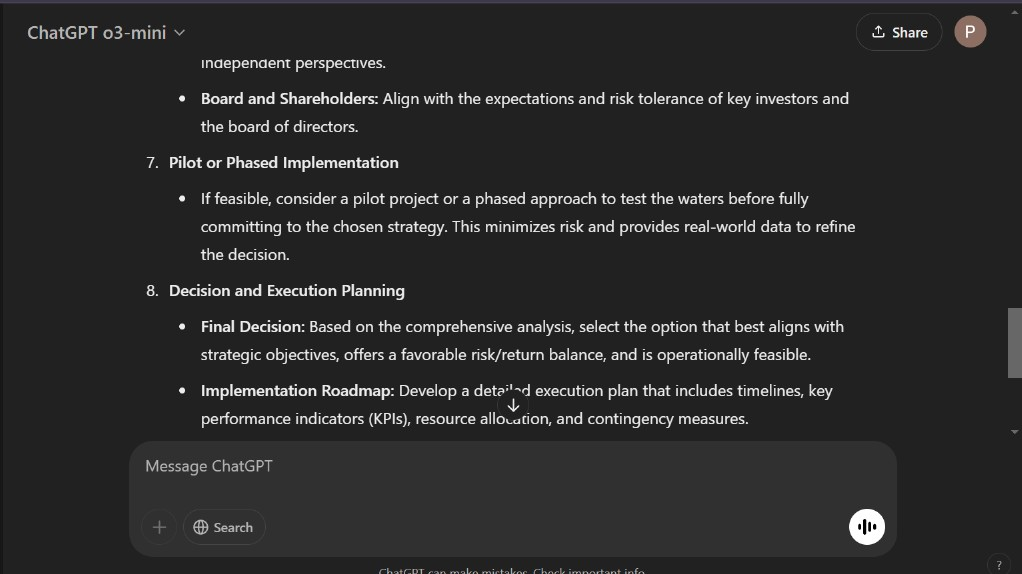

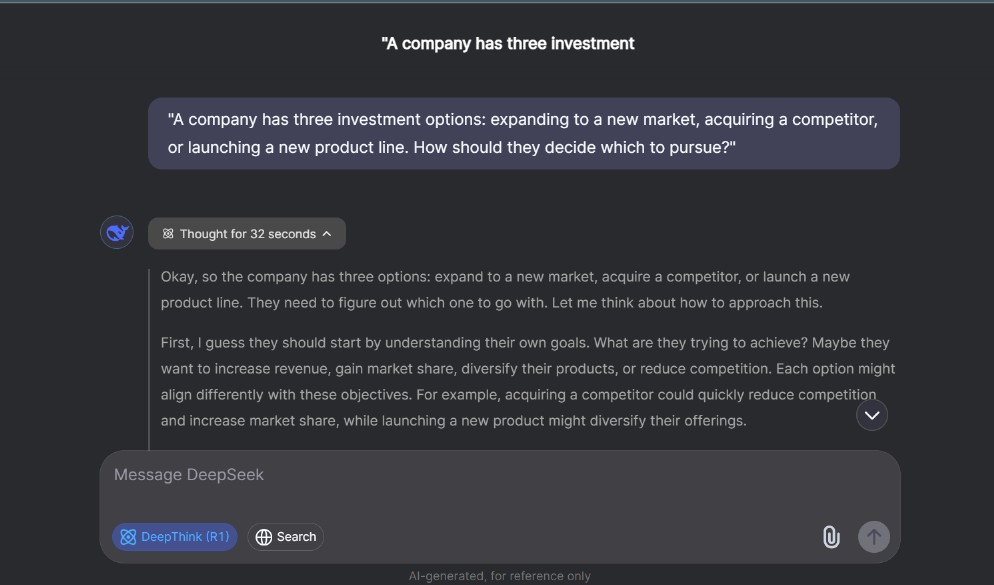

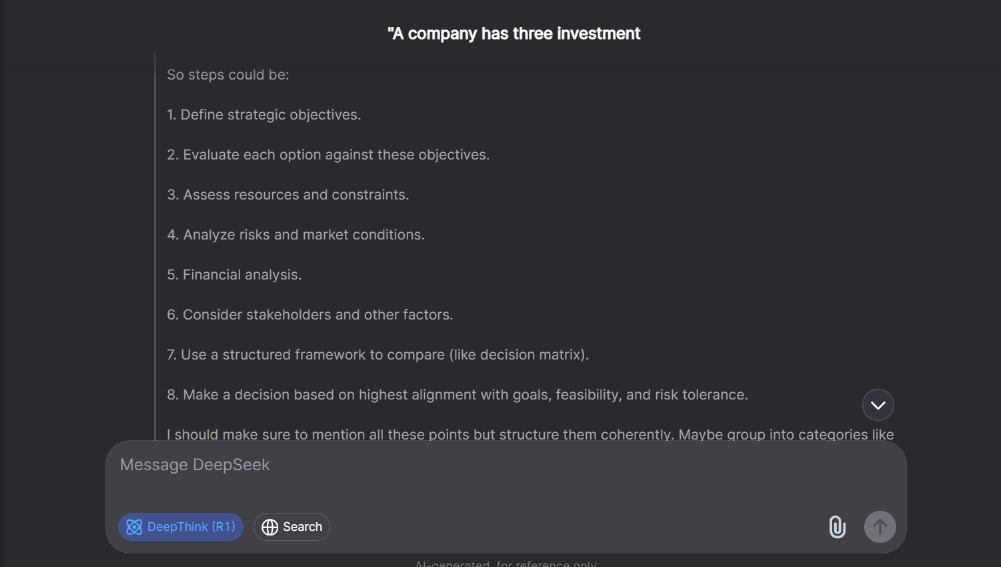

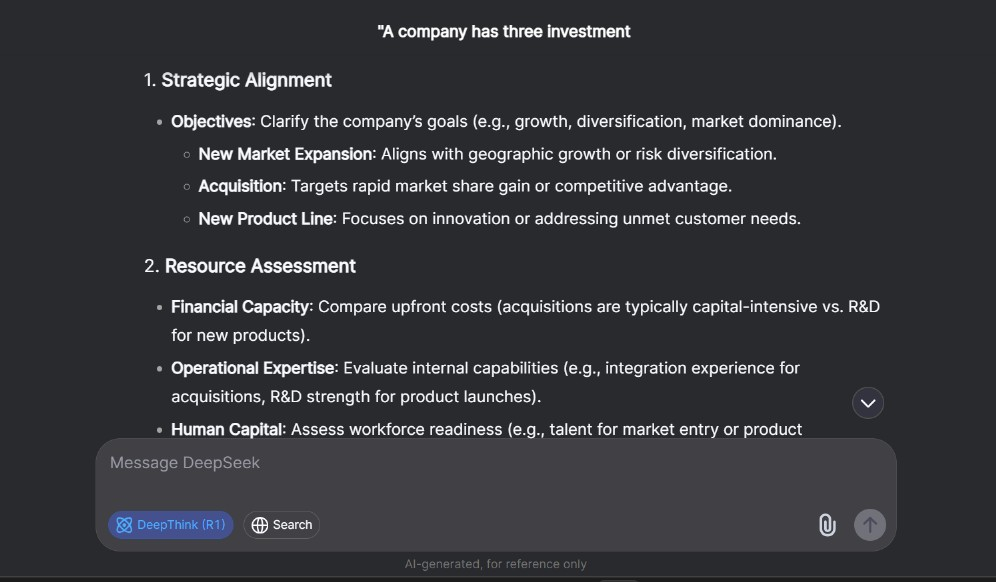

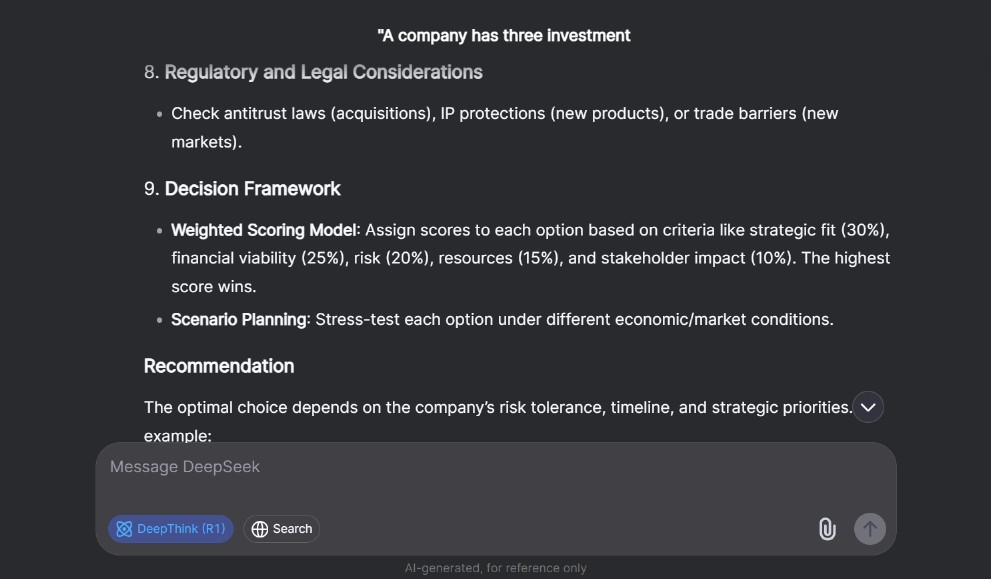

Wir haben o3 mini und R1 eine Frage zu geschäftlichen Überlegungen gestellt und hier finden Sie die Antworten:

ChatGPT o3-mini: Hatte eine schnellere Antwortrate mit klareren und präziseren Antworten.

Tiefseek R1: Die Reaktionszeit für das Problem betrug 32 Sekunden, was im Vergleich zu 6 Sekunden bei o3-mini sehr hoch ist. Die Antwort ist jedoch viel detaillierter und ausführlicher.

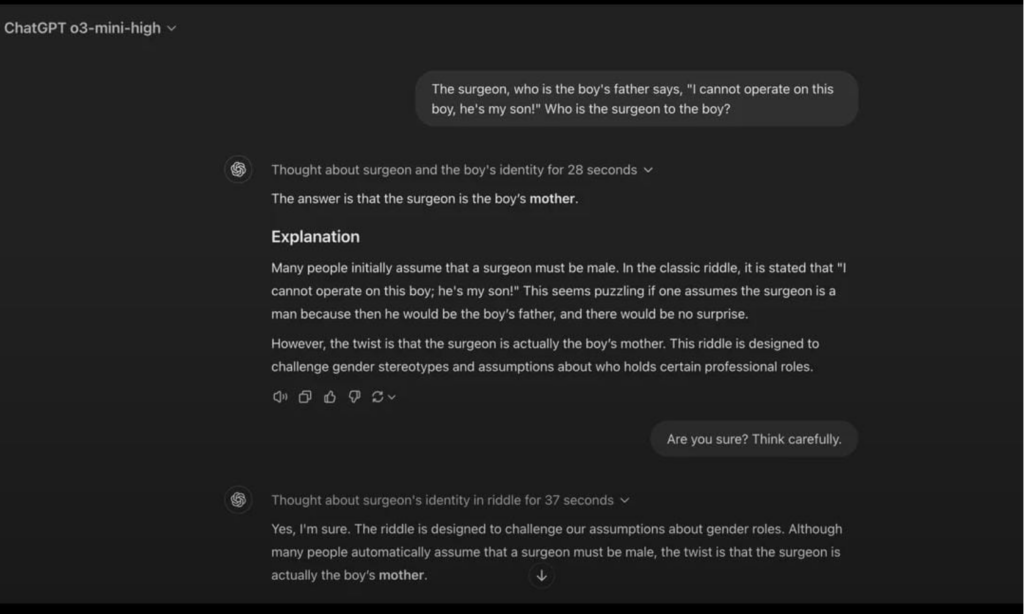

Kontextuelles und logisches Denken

Es wurde eine Testfrage entwickelt, bei der die KI eine Antwort aus einer impliziten Bedeutung und nicht aus direkten Informationen erschließen musste.

- ChatGPT o3-mini: Hat eine vernünftige Antwort gegeben, aber ein subtiles Detail im Kontext übersehen.

- DeepSeek R1: Den Kontext vollständig verstanden, die richtige Antwort abgeleitet und die Gründe dafür erklärt.

Wenn Sie also eine KI brauchen, die in Gesprächen oder beim abstrakten Denken „den Hinweis versteht“, ist DeepSeek R1 die Nase vorn.

Kostenvergleich: Was ist günstiger?

OpenAI hat seine ChatGPT o3-mini-Preisstruktur für kostenbewusste Unternehmen optimiert und gleichzeitig seine Premium-Positionierung beibehalten.

- Eingabetoken: Standardrate: $1,10 pro Million Token, Batch-API-Rate: $0,55 pro Million Token (für Unternehmen, die sofortige Antworten gegen eine 24-Stunden-Stapelverarbeitung eintauschen möchten)

- Ausgabetoken: Standardrate: $4,40 pro Million Token, Batch-API-Rate: $2,20 pro Million Token

Dieses Modell macht eines ganz klar: OpenAI zielt auf Effizienz im Unternehmensmaßstab ab.

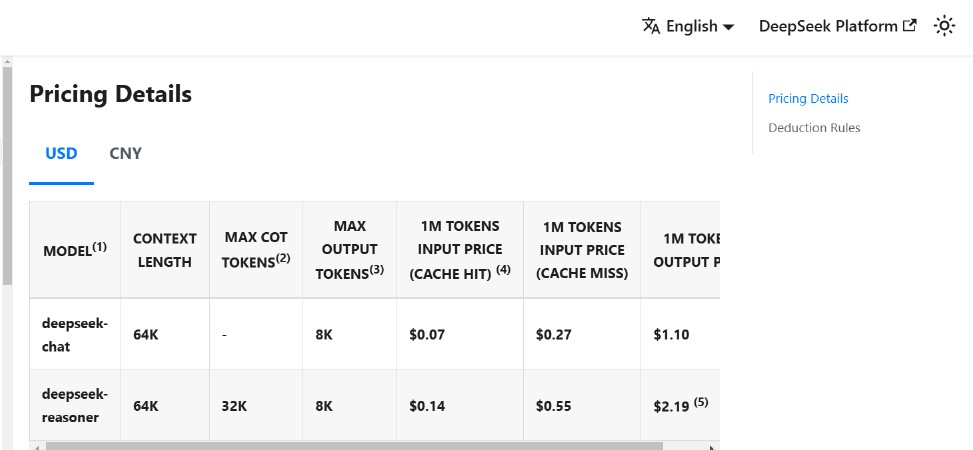

DeepSeek R1 spielt ein völlig anderes Spiel. Anstatt Unternehmen in einen geschlossenen Raum einzusperren, setzt DeepSeek auf Open-Source-KI und transparente Preise, um Entwickler und Unternehmen zu gewinnen, die KI zu ihren eigenen Bedingungen wollen.

- Eingabetoken: Cache-Treffer: $0,14 pro Million Token, Cache-Fehler: $0,55 pro Million Token

- Ausgabetoken: $2,19 pro Million Token

Was bedeutet das in der Praxis? Wenn die API von DeepSeek bereits zuvor eine ähnliche Anfrage verarbeitet hat (Cache-Treffer), zahlen Sie so gut wie nichts. Für Unternehmen, die vorhersehbare, sich wiederholende KI-Workloads verwenden, bedeutet dies im Laufe der Zeit enorme Kosteneinsparungen.

Vergleicht man das mit OpenAIs Minimum von $1,10 pro Million Eingabe-Token, wird klar, warum die Preisgestaltung von DeepSeek eine ernsthafte Herausforderung für das Geschäftsmodell von OpenAI darstellt.

Treffen Sie Ihre Wahl

Wenn Sie eine direkte Empfehlung suchen:

Wählen Sie ChatGPT o3-mini, wenn Sie glauben, dass KI ein Tool sein sollte, das einfach funktioniert. Es ist das Modell für Leute, die Dinge erledigen wollen, ohne sich Gedanken über das Wie und Warum zu machen.

Wählen Sie DeepSeek R1, wenn Sie glauben, dass KI ein kollaborativer Partner sein sollte. Es ist für neugierige Köpfe, die verstehen, basteln und vielleicht sogar verbessern möchten, womit sie arbeiten.

Was denkt das Internet?

Abschluss

KI steht an einem Scheideweg. Open Source vs. geschlossen. Anpassbar vs. kontrolliert. Innovation für alle vs. Pay-to-Play.

DeepSeek R1 geht eine mutige Wette ein: KI sollte offen, anpassungsfähig und zugänglich sein. Beim o3-mini von OpenAI dreht sich dagegen alles um Effizienz, Geschwindigkeit und erstklassige Leistung.

So oder so zwingt DeepSeek die KI-Branche, ihre Wettbewerbsfähigkeit neu zu überdenken. Sein Ansatz durchbricht traditionelle Vorstellungen davon, was KI erfolgreich macht, und selbst Regierungen beginnen, dies zu bemerken. Da KI die globalen Machtstrukturen prägt, müssen sich die Länder nun fragen: Basiert Dominanz auf proprietärer KI oder liegt wahrer Erfolg in offener Innovation?

Die Entscheidung ist nicht nur technischer Natur. Sie ist ideologischer Natur.

Abonnieren Sie, um die neuesten Blogbeiträge zu erhalten

Hinterlassen Sie Ihren Kommentar: